深度报告:大模型驱动 AI 全面提速!黄金十年开启

source link: https://www.51cto.com/article/712461.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

经历过去 70 年的“三起两落”,伴随底层芯片、算力、数据等基础设施的完善&进步,全球 AI 产业正逐步从运算智能走向感知智能、认知智能,并相应形成“芯片、算力设施、AI 框架&算法模型、应用场景”的产业分工、协作体系。2019年以来,AI 大模型带来问题泛化求解能力大幅提升,“大模型+小模型”逐步成为产业主流技术路线,驱动全球 AI 产业发展全面加速,并形成“芯片+算力基础设施+AI 框架&算法库+应用场景”的稳定产业价值链结构。

本期的智能内参,我们推荐中信证券的报告《大模型驱动 AI 全面提速,产业黄金十年投资周期开启》,解读人工智能产业现状和产业发展核心问题。来源:中信证券

一、人工智能的“三起三落”

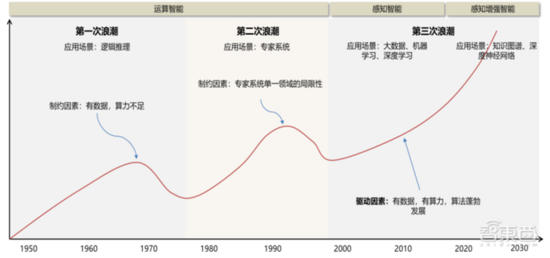

自 1956 年“人工智能”概念&理论首次被提出,AI 产业&技术发展主要经历三大发展阶段。

1 ) 20 世纪 50 年代 ~20 世纪 70 年代:受制于算力性能、数据量等,更多停留在理论 层面。 1956 年达特茅斯会议推动了全球第一次人工智能浪潮的出现,当时乐观的气氛弥漫着整个学界,在算法方面出现了很多世界级的发明,其中包括一种叫做增强学习的雏形,增强学习就是谷歌 AlphaGo 算法核心思想内容。而 70 年代初,AI 遭遇了瓶颈:人们发现逻辑证明器、感知器、增强学习等只能做很简单、用途狭隘的任务,稍微超出范围就无法应对。当时的计算机有限的内存和处理速度不足以解决任何实际的 AI 问题。这些计算复杂度以指数程度增加,成为了不可能完成的计算任务。

2 ) 20 世纪 80 年代 ~20 世纪 90 年代:专家系统是人工智能的第一次商业化尝试,高 昂的硬件成本、有限的适用场景限制了市场的进一步向前发展。 在 80 年代,专家系统 AI程序开始为全世界的公司所采纳,而“知识处理”成为了主流 AI 研究的焦点。专家系统的能力来自于它们存储的专业知识,知识库系统和知识工程成为了 80 年代 AI 研究的主要方向。但是专家系统的实用性仅仅局限于某些特定情景,不久后人们对专家系统的狂热追捧转向巨大的失望。另一方面,1987 年到 1993 年现代 PC 的出现,其费用远远低于专家系统所使用的 Symbolics 和 Lisp 等机器。相比于现代 PC,专家系统被认为古老陈旧而非常难以维护。于是,政府经费开始下降,寒冬又一次来临。

3 ) 2015 年至今:逐步形成完整的产业链分工、协作体系。 人工智能第三起的标志性事件发生在 2016 年 3 月,谷歌 DeepMind 研发的 AlphaGo 在围棋人机大战中击败韩国职业九段棋手李世石。随后,大众开始熟知人工智能,各个领域的热情都被调动起来。这次事件确立了以 DNN 神经网络算法为基础的统计分类深度学习模型,这类模型相比于过往更加泛化,通过不同的特征值提取可以适用于不同的应用场景中。同时,2010 年-2015 年移动互联网的普及也为深度学习算法带来了前所未有的数据养料。得益于数据量的上涨、运算力的提升和机器学习新算法的出现,人工智能开始大调整。人工智能的研究领域也在不断扩大,包括专家系统、机器学习、进化计算、模糊逻辑、计算机视觉、自然语言处理、推荐系统等。深度学习的发展,让人工智能进入新的发展高潮。

▲ 人工智能发展的三次浪潮

人工智能第三次浪潮带给我们一批能给商业化落地的场景,DNN 算法的出色表现让语音识别与图像识别在安防、教育领域贡献了第一批成功的商业案例。而近年来基于神经网络算法之上的 Transformer 等算法的开发让 NLP(自然语言处理)的商业化也提上了日程,有望在未来 3-5 年看到成熟的商业化场景。

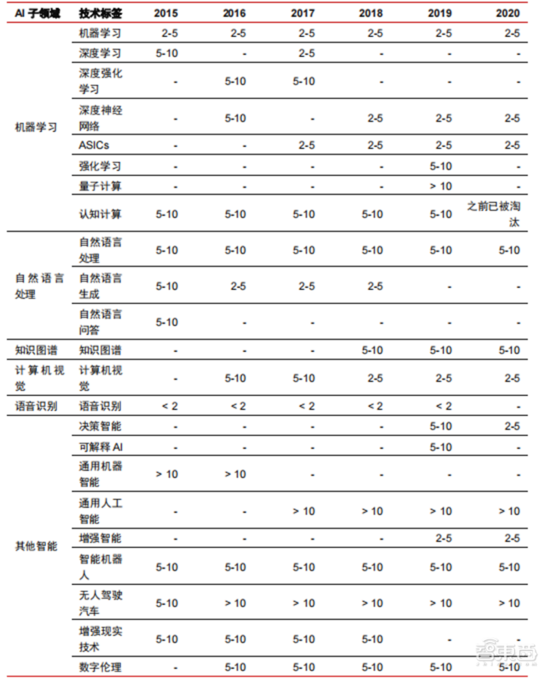

▲ 人工智能技术产业化所需年数

二、分工逐步完整,落地场景不断拓展

经历过去 5~6 年的发展,全球 AI 产业正逐步形成分工协作、完整的产业链结构,并开始在部分领域形成典型应用场景。

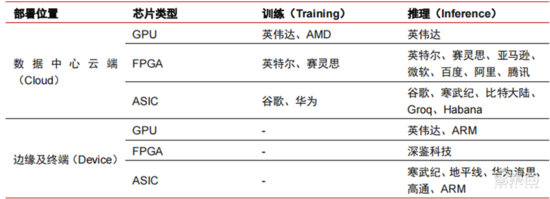

1、AI 芯片:从 GPU 到 FPGA 、 ASIC 等,性能不断提升

芯片是 AI 产业的制高点 。本轮人工智能产业繁荣,缘于大幅提升的 AI 算力,使得深度学习和多层神经网络算法成为可能。 人 工智能在各个行业迅速渗透,数据随之海量增长,这导致算法模型极其复杂,处理对象异构,计算性能要求高。因此人工智能深度学习需要异常强大的并行处理能力,与 CPU 相比,AI 芯片拥有更多逻辑运算单元(ALU)用于数据处理,适合对密集型数据进行并行处理,主要类型包括图形处理器(GPU)、现场可编程门阵列(FPGA)、专用集成电路(ASIC)等。

从使用场景来看,相关硬件包括:云侧推理芯片、云侧测试芯片、终端处理芯片、IP 核心等。在云端的“训练”或“学习”环节,英伟达 GPU 具备较强竞争优势,谷歌 TPU 亦在积极拓展市场和应用。在终端的“推理”应用领域 FPGA 和 ASIC 可能具备优势。美国在 GPU 和 FPGA 领域具有较强优势,拥有英伟达、赛灵思、AMD 等优势企业,谷歌、亚马逊亦在积极开发 AI 芯片。

▲ 芯片在不同 AI 环节的应用

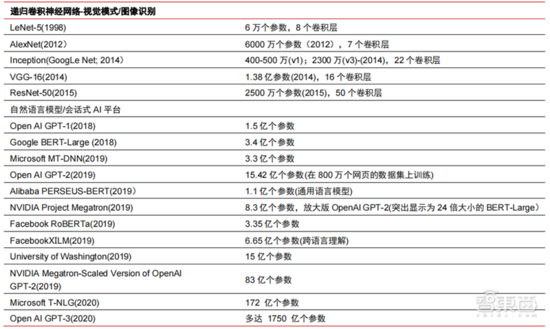

▲ 人工智能神经网络算法模型复杂度

▲ 芯片厂商布局

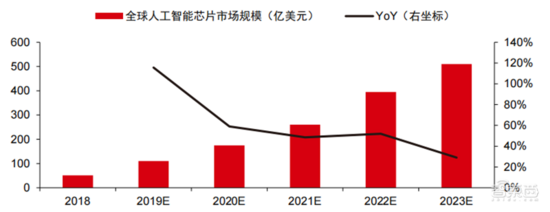

在高性能计算市场,借助 AI 芯片的并行运算能力实现对复杂问题的求解是目前的主流方案。据 Tractica 数据显示,2019 年全球 AI HPC市场规模约 13.6 亿美元,预计到 2025 年市场规模达 111.9 亿美元,7 年 CAGR 为 35.1%。AI HPC 市场规模占比由 2019 年的 13.2%提高至 2025 年的 35.5%。同时 Tractica 数据显示,2019 年全球 AI 芯片市场规模为 64 亿美元,预计到 2023 年市场规模达 510 亿美元,市场空间增长近 10 倍。

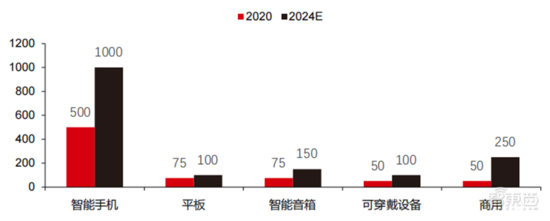

▲ 边缘计算芯片出货量(百万,按终端设备)

▲ 全球人工智能芯片市场规模(亿美元)

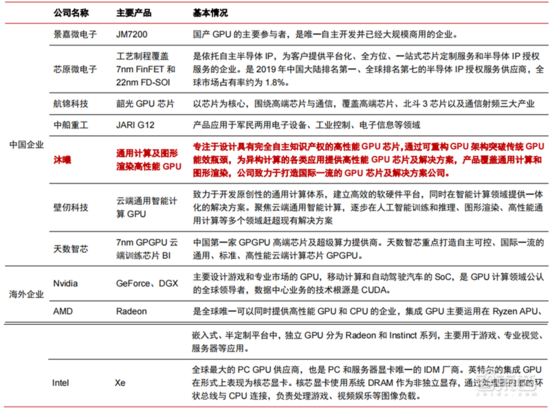

近两年内,国内涌现了大量自研的芯片类公司,以自研 GPU 的摩尔线程、自研自动驾驶芯片的寒武纪等为代表。摩尔线程于 2022 年 3 月发布了 MUSA 统一系统架构及第一代芯片“苏堤”,摩尔线程的新架构支持英伟达的 cuda 架构。根据 IDC 数据,在 2021 年上半年中国人工智能芯片中,GPU 一直是市场首选,占有 90%以上的市场份额,但随其他芯片的稳步发展,预计到 2025 年 GPU 占比将逐步降低至 80%。

▲ GPU 芯片主要玩家及技术路线情况

2、 算力设施:借助云计算、自建等方式,算力规模、单位成本等指标不断改善

过去算力发展有效缓解了人工智能的发展瓶颈。 人工智能作为一个年代久远的概念,过去的发展一直受限于算力不足,其算力需求的主要来源于两个方面:1)人工智能最大挑战之一是识别度与准确度不高,而要提高准确度就需要提高模型的规模和精确度,这就需要更强的算力支撑。2)随着人工智能的应用场景逐渐落地,图像、语音、机器视觉和游戏等领域的数据呈现爆发性增长,也对算力提出了更高的要求,使得计算技术进入新一轮高速创新期。而过去十几年算力的发展有效缓解了人工智能的发展瓶颈,未来智能计算将呈现出需求更大、性能要求更高、需求随时随地且多样化的特点。

由于接近物理极限,算力增长的摩尔定律逐步失效,算力行业正处于多要素综合创新 阶段。 过去算力供应提升主要通过工艺制程微缩,即在同一芯片内增加晶体管堆叠的数量来提高计算性能。但随着工艺制程不断逼近物理极限,成本不断提高,使得摩尔定律逐渐失效,算力产业进入后摩尔时代,算力供应需要通过多要素综合创新提高。当前算力供给有四个层面:单芯片算力、整机算力、数据中心算力和网络化算力,分别通过不同技术进行持续演进升级,以满足智能时代多样化算力的供给需求。此外,通过软硬件系统的深度融合与算法优化提升计算系统整体性能,也是算力产业演进的重要方向。

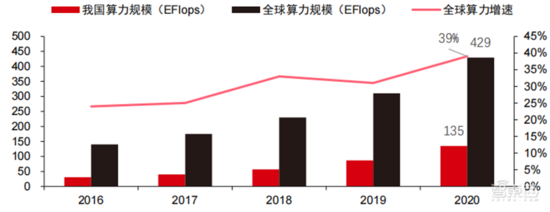

算力规模: 根据中国信通院 2021 年发布的《中国算力发展指数白皮书》,2020 年全球算力总规模依旧保持增长态势,总规模达 429EFlops,同比增长 39%,其中基础算力规模 313EFlops、智能算力规模 107EFlops、超算算力规模 9EFlops,智能算力占比有所提高。我国算力发展节奏与全球相似,2020 年我国算力总规模达到 135EFlops,占全球算力规模的 39%,实现 55%的高位增长,并实现连续三年增速保持 40%以上。

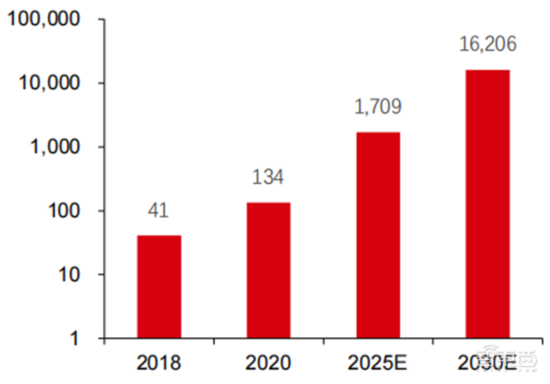

▲ 全球算力规模变化

算力结构 :我国与全球发展情况相似,智能算力增长迅速,占比从 2016 年的 3%提升至 2020 年的 41%。而基础算力占比由 2016 年的 95%下降至 2020 年的 57%,在下游需求驱动下,以智能计算中心为代表的人工智能算力基础设施发展迅猛。同时在未来需求方面,根据华为 2020 年发布的《泛在算力:智能社会的基石》报告,随着人工智能的普及,预计到 2030 年,人工智能算力的需求将相当于 1600 亿颗高通骁龙 855 内置 AI 芯片,相当于 2018 年的约 390 倍、2020 年的约 120 倍。

▲ 预计 2030 年人工智能算力需求(EFlops)

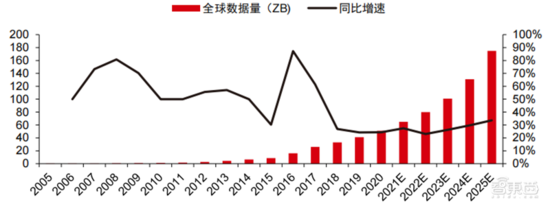

数据存储:非关系型数据库以及用于储存、治理非结构数据的数据湖迎来需求爆发。 近年来全球数据量呈现爆发式增长,据 IDC 统计,2019 年全球产生的数据量为 41ZB,过去十年的 CAGR 接近 50%,预计到 2025 年全球数据量或高达 175ZB,2019-2025 年仍将维持近 30%的复合增速,其中超过 80%的数据都将是处理难度较大的文本、图像、音视频等非结构化数据。数据量(尤其是非结构化数据)的激增使得关系型数据库的弱点愈加凸显,面对几何指数增长的数据,传统为结构型数据设计的关系型数据库纵向叠加的数据延展模式难以满足。

非关系型数据库以及用于储存、治理非结构数据的数据湖,因其灵活性以及易延展性逐渐占据市场中越来越多的份额。根据 IDC,2020 年全球 Nosql 数据库的市场规模为 56 亿美元,预计 2025 年将增长至 190 亿美元,2020-2025 年复合增速为 27.6%。同时,根据 IDC,2020 年全球数据湖市场规模为 62 亿美元,2020 年市场规模增速为 34.4%。

▲ 全球数据量及同比增速(ZB,%)

3、AI 框架:相对趋于成熟,少数巨头主导

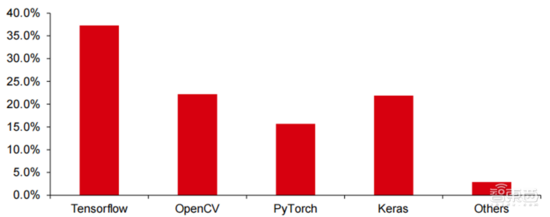

Tensorflow (产业界)、 PyTorch (学术界)逐步实现主导。 谷歌推出的 Tensorflow为主流与其他开源模块如 Keras(Tensorflow2 集成了 Keras 模块)、Facebook 开源的PyTorch 等一起构成了目前 AI 学习的主流框架。Google Brain 自 2011 年成立起开展了面向科学研究和谷歌产品开发的大规模深度学习应用研究,其早期工作即是 TensorFlow 的前身 DistBelief。DistBelief 在谷歌和 Alphabet 旗下其他公司的产品开发中被改进和广泛使用。2015 年 11 月,在 DistBelief 的基础上,谷歌大脑完成了对“第二代机器学习系统”TensorFlow 的开发并对代码开源。相比于前作,TensorFlow 在性能上有显著改进、构架灵活性和可移植性也得到增强。

Tensorflow 与 Pytorch 虽然本身是开源模块,但因为深度学习框架庞大的模型与复杂度导致其修改与更新基本完全是由谷歌完成,从而谷歌与 Facebook 也通过对 Tensorflow与 PyTorch 的更新方向直接主导了产业界对人工智能的开发模式。

▲ 全球商用人工智能框架市场份额结构(2021)

Microsoft 在 2020 年以 10 亿美元注资 OpenAI,获得 GPT-3 语言模型的独家许可。GPT-3 是目前在自然语言生成中最为成功的应用,不仅可以用于写“论文”,也可以应用于“自动生成代码”,自今年 7 月发布后,也被业界视为最强大的人工智能语言模型。而Facebook 早在 2013 年创立了 AI 研究院,FAIR 本身并没有像 AlphaGo 和 GPT-3 那样著名的模型和应用,但是它的团队已经在 Facebook 本身感兴趣的领域发表了学术论文,包括计算机视觉、自然语言处理和对话型 AI 等。2021 年,谷歌有 177 篇论文被 NeurIPS(目前人工智能算法的最高期刊)接收并发表,Microsoft 有 116 篇,DeepMind 有 81 篇,Facebook 有 78 篇,IBM 有 36 篇,而亚马逊只有 35 篇。

4、 算法模型:神经网络算法为主要理论基础

深度学习正在向深度神经网络过渡。 机器学习是通过多层非线性的特征学习和分层特征提取,对图像、声音等数据进行预测的计算机算法。深度学习为一种进阶的机器学习,又称深度神经网络(DNN:Deep Neural Networks )。针对不同场景(信息)进行的训练和推断,建立不同的神经网络与训练方式,而训练即是通过海量数据推演,优化每个神经元的权重与传递方向的过程。而卷积神经网络,能考虑单一像素与周边环境变量,并简化数据提取数量,进一步提高神经网络算法的效率。

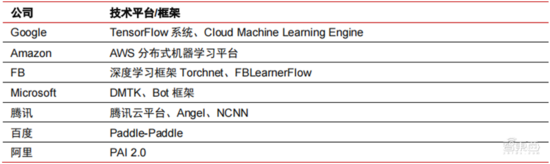

神经网络算法成为大数据处理核心。 AI 通过海量标签数据进行深度学习,优化神经网络与模型,并导入推理决策的应用环节。90 年代是机器学习、神经网络算法快速崛起的时期,算法在算力支持下得到商用。90 年代以后,AI 技术的实际应用领域包括了数据挖掘、工业机器人、物流、语音识别、银行业软件、医疗诊断和搜索引擎等。相关算法的框架成为科技巨头的布局重点。

▲ 主要科技巨头算法平台框架

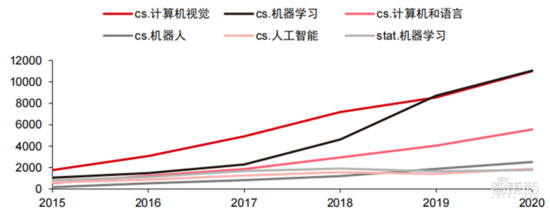

技术方向上,计算机视觉与机器学习为主要的技术研发方向。 根据 ARXIV 数据,从理论研究的角度看,计算机视觉和机器学习两个领域在 2015-2020 年发展迅速,其次是机器人领域。2020 年,ARXIV 上 AI 相关出版物中,计算机视觉领域出版物数量超过 11000,位于 AI 相关出版物数量之首。

▲ 2015-2020 年 ARXIV 上 AI 相关出版物数量

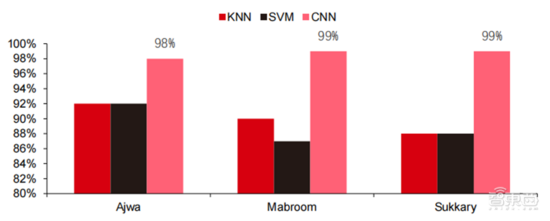

在过去五年,我们观察到以 CNN 与 DNN 为主的神经网络算法是近年来发展最快的机器学习算法,因其在计算机视觉、自然语言处理等领域中的优异表现,大幅加快了人工智能应用的落地速度,是计算机视觉、决策智能迅速迈向成熟的关键因素。从侧视图可以看出,在语音识别任务上,标准的 DNN 方法相较于传统的 KNN、SVM 与随机森林等方法都有着明显的优势。

▲ 卷积算法突破了传统图像处理的准确度瓶颈,首次实现工业化可用

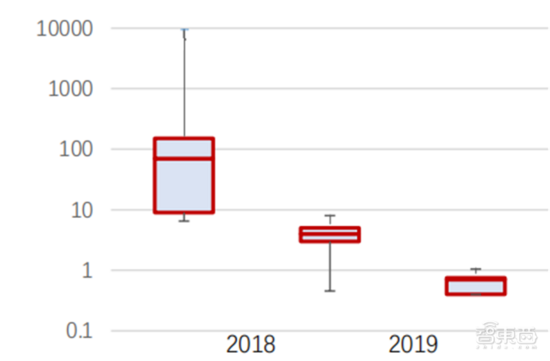

训练成本上看,神经网络算法训练人工智能的成本明显降低。 ImageNet 是一个包含超过 1400 万张图像的数据集,用于训练人工智能算法。根据斯坦福 DAWNBench 团队的测试,2020 年训练一个现代的图像识别系统仅需约 7.5 美元,比 2017 年的 1100 美元下降了 99%以上,这主要受益于算法设计的优化、算力成本的下降,以及大规模人工智能训练基础设施的进步。训练系统的速度越快,评估并用新数据更新系统的速度就越快,这将进一步加快 ImageNet 系统的训练速度,提高开发和部署人工智能系统的生产力。

训练时间分布上看,神经网络算法训练所需时间全面降低。 通过分析每个时期的训练时间分布,发现在过去几年中,训练时间大大缩短,且训练时间的分布更加集中,这主要受益于加速器芯片的广泛使用。

▲ ImageNet 训练时间分布(分钟)

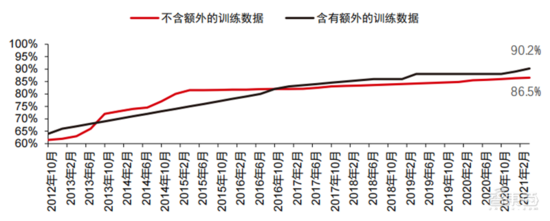

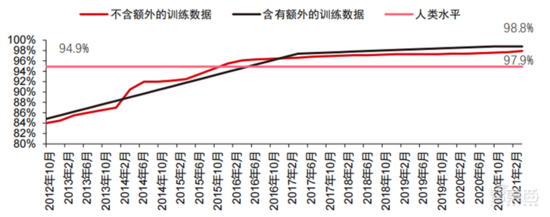

在卷积神经网络的推动下,计算机视觉准确率测试成绩明显提升,正处于产业化阶段。 计算机视觉准确率在过去的十年中取得了巨大的进步,这主要归功于机器学习技术的应用。Top-1 准确度测试人工智能系统为图像分配正确标签的能力越强,那么其预测结果(在所有可能的标签中)与目标标签越相同。在有额外的训练数据(例如来自社交媒体的照片)的情况下,2021 年 1 月在 Top-1 准确度测试上每 10 次尝试中会出现 1 次错误,而 2012年 12 月每 10 次尝试中会出现 4 次错误。而另一项精确率测试 Top-5 会让计算机回答目标标签是否在分类器的前五个预测中,其准确率从 2013 年的 85%提高到 2021 年的 99%,超过了代表人类水平的成绩 94.9%。

▲ TOP-1 准确率变化

▲ TOP-5准确率变化

在神经网络算法发展的过程中, Transformer 模型在过去五年里成为了主流,整合了 过去各种零散的小模型。 Transformer 模型是谷歌在 2017 年推出的 NLP 经典模型(Bert就是用的 Transformer)。模型的核心部分通常由两大部分组成,分别是编码器与解码器。编/解码器主要由两个模块组合成:前馈神经网络(图中蓝色的部分)和注意力机制(图中玫红色的部分),解码器通常多一个(交叉)注意力机制。编码器和解码器通过模仿神经网络对数据进行分类与再次聚焦,在机器翻译任务上模型表现超过了 RNN 和 CNN,只需要编/解码器就能达到很好的效果,可以高效地并行化。

AI 大模型化是过去两年内兴起的新潮流,自监督学习 + 预训练模型微调适配方案逐渐 成为主流, AI 模型走向大数据支撑下的泛化成为可能。 传统的小模型用特定领域有标注的数据训练,通用性差,换到另外一个应用场景中往往不适用,需要重新训练。而 AI 大模型通常是在大规模无标注数据上进行训练,将大模型进行微调就可以满足多种应用任务的需要。以 OpenAI、谷歌、微软、Facebook、NVIDIA 等机构为代表,布局大规模智能模型已成为全球引领性趋势,并形成了 GPT-3、Switch Transformer 等大参数量的基础模型。

2021 年底英伟达与微软联合开发的 Megatron-LM 拥有 83 亿条参数,而 Facebook 开发的Megatron 拥有 110 亿条参数。这些参数大多来自于 reddit、wikipedia、新闻网站等,对大量数据存储及分析所需的数据湖等工具将会是下一步研发的焦点之一。

5、应用场景: 逐步在安防、互联网、零售等领域实现落地

目前在应用端最成熟的技术是语音识别、图像识别等,围绕这些领域,国内、美国都 有大量的企业上市,并形成一定的产业集群。 在语音识别领域,比较成熟的上市企业包括科大讯飞与此前被微软以 290 亿美元收购的 Nuance。

智慧医疗: AI+ 医疗多应用于医疗辅助场景。 在医疗健康领域的 AI 产品涉及智能问诊、病史采集、语音电子病历、医疗语音录入、医学影像诊断、智能随访、医疗云平台等多类应用场景。从医院就医流程来看,诊前产品多为语音助理产品,如导诊、病史采集等,诊中产品多为语音电子病例、影像辅助诊断,诊后产品以随访跟踪类为主。综合整个就诊流程中的不同产品,当前 AI+医疗的主要应用领域仍以辅助场景为主,取代医生的体力及重复性劳动。AI+医疗的海外龙头企业是 Nuance,公司 50%的业务来自智能医疗解决方案,而病历等临床医疗文献转写方案是医疗业务的主要收入来源。

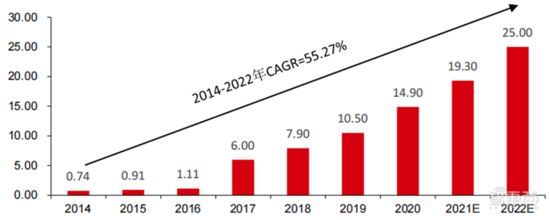

智慧城市:大城市病和新型城镇化给城市治理带来新挑战,刺激 AI+ 城市治理的需求。 大中型城市随着人口和机动车数量的增加,城市拥堵等问题比较突出。随着新型城镇化的推进,智慧城市将会成为中国城市的主要发展模式。而智慧城市涉及的 AI+安防、AI+交通治理将会成为 G 端的主要落地方案。2016 年杭州首次进行城市数据大脑改造,高峰拥堵指数下降至 1.7 以下。目前以阿里为代表的城市数据大脑已经进行了超过 15 亿元的投资,主要集中在智能安防、智能交通等领域。我国智慧城市产业规模持续扩大,前瞻产业研究院预计 2022 年可达 25 万亿元,2014 年至 2022 年的年均复合增长率为 55.27%。

▲ 2014-2022 年智慧城市市场规模及预测(单位:万亿元)

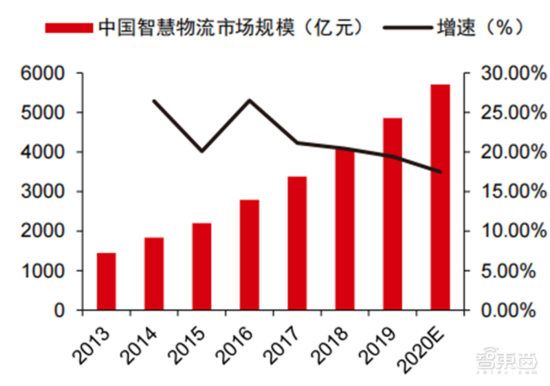

智慧物流 2020 年市场规模高达 5710 亿元,智能仓储迎来千亿市场。 物流行业成本居高不下及数字化转型的背景下,仓储物流及产品制造环节面临着自动化、数字化、智能化转型的迫切需求,以提升制造和流通效率。根据中国物流与采购联合会的数据,2020年中国智慧物流市场高达5710亿元,2013-2020年的年均复合增长率为21.61%。物联网、大数据、云计算、人工智能等新一代信息技术既促进了智慧物流行业的发展,又对智慧物流行业提出了更高的服务要求,智慧物流市场规模有望持续扩大。据 GGII 测算,2019 年中国智能仓储市场规模近 900 亿元,而前瞻研究院预计这一数字将在 2025 年达到 1500亿以上。

▲ 2013-2020 年中国智慧物流市场规模及增速

新零售:人工智能将带来人力成本的缩减与运营效率的提升。 Amazon Go 为亚马逊提出的无人商店概念,无人商店于 2018 年 1 月 22 日在美国西雅图正式对外营运。AmazonGo 结合了云计算和机器学习,应用拿了就走技术(Just Walk Out Technology)和智能识别技术(Amazon Rekognition)。店内的相机、感应监测器以及背后的机器算法会辨识消费者拿走的商品品项,并且在顾客走出店时将自动结账,是零售商业领域的全新变革。

云化的人工智能模块组件是各大互联网巨头目前在人工智能商业化的主要发力方向, 将人工智能技术集成在公有云服务中进行出售。 Google Cloud Platform 的 AI 技术一直走在行业的最前沿,并致力于将先进的 AI 技术融入云计算服务中心。近年来,谷歌收购多家AI 公司,并发布 AI 专用芯片 TPU、云服务 Cloud AutoML 等产品完善布局。目前谷歌的AI 能力已经覆盖认知服务、机器学习、机器人、数据分析&协作等领域。区别于部分云厂商在 AI 领域相对分散的产品,谷歌在 AI 产品的运营上更加完整和体系化,将垂直应用整合为 AI 基础组件,将 Tensorflow 与 TPU 运算整合为基础设施,形成了一个完整的 AI 平台服务。

百度是中国 AI 能力最强的公有云厂商,百度 AI 的核心战略是开放赋能。 百度搭建以DuerOS、Apollo 为代表的 AI 平台,开放生态,形成数据与场景的正向迭代。基于百度互联网搜索的数据基础,自然语言处理、知识图谱和用户画像技术逐步成熟。在平台以及生态层,百度云是很大的计算平台,开放给所有的合作伙伴,变成基础的支撑平台,上面有百度大脑的各种能力。同时还有一些垂直的解决方案,比如基于自然语言的人机交互的新一代操作系统,以及与智能驾驶相关的 Apollo。整车厂商可以调用其中他们需要的能力,汽车电子厂商也可以调用他们需要的相应能力,共建整个平台和生态。

三、 产业变化: AI 大模型逐步成为主流,产业发展有望全 面提速

最近几年来,AI 产业的技术演进路线主要呈现如下特征:底层模块性能的不断提升,注重模型的泛化能力,从而帮助 AI 算法的通用性优化,并反哺数据收集。AI 技术的持续发展依靠底层算法的突破,这同时需要以算力为核心的基础能力建设以及有大数据支撑进行知识和经验学习的环境。大模型在产业内的快速流行,大模型+小模型的运作模式,以及芯片、算力基础设施等底层环节能力的不断改善,以及由此带来的应用场景类别、场景深度的持续提升,并最终带来产业基础能力、应用场景之间的不断相互促进,并在正向循环逻辑下,驱动全球 AI 产业发展不断提速。

大模型带来较强的通用问题求解能力。 当前大部分人工智能正处于“手工作坊式”,面对各类行业的下游应用,AI 逐渐展现出碎片化、多样化的特点,模型通用性不高。为提高通用求解能力,大模型提供了一种可行方案,即“预训练大模型+下游任务微调”。该方案指从大量标记和未标记的数据中捕获知识,通过将知识存储到大量的参数中并对特定任务进行微调,提高模型泛化能力。

大模型有望进一步突破现有模型结构的精度局限,结合嵌套小模型训练,进一步提升 特定场景下的模型效率。 过去十年中,模型精度提升主要依赖网络在结构上的变革,但随着神经网络结构设计技术逐渐成熟并趋于收敛,精度提升达到瓶颈,而大模型的应用有望突破这一瓶颈。以谷歌的视觉迁移模型 Big Transfer,BiT 为例,使用 ILSVRC-2012(128万张图片,1000 个类别)和 JFT-300M(3 亿张图片,18291 个类别)两个数据集来训练ResNet50,精度分别是 77%和 79%,大模型的使用使得处于瓶颈的精度进一步提高。另外使用 JFT-300M 训练 ResNet152x4,精度可以上升到 87.5%,相比 ILSVRC-2012+ResNet50 结构提升了 10.5%。

大模型 + 小模型 :泛化大模型人工智能的推广并结合特定场景下的数据优化将成为中期人工智能产业商业化的关键。原先针对特定场景重新提取数据训练的模式,已经被实践证明难以盈利,重新训练模型的成本过高,而获得的模型泛用性低下,难以重复利用。而在芯片算力性能不断提高的大背景下,大模型嵌套小模型的尝试提供给了厂商另一个思路,通过分析海量数据获得泛用模型,再通过嵌套特定小模型的方式为不同场景进行优化,节省了大量成本。阿里云、华为云、腾讯云等公有云厂商都在积极开发自研的大模型平台,提升模型的通用型。

以英伟达为代表的 AI 芯片巨头,在新一代芯片中针对产业中常用的 AI 模型,特别设 计了新引擎以大幅提升计算能力。 英伟达的 Hopper 架构引入了 Transformer 引擎,大幅加速了 AI 训练。Transformer 引擎采用软件和自定义 NVIDIA Hopper Tensor Core 技术,该技术旨在加速训练基于常见 AI 模型构建模块(即 Transformer)构建的模型。这些Tensor Core 能够应用 FP8 和 FP16 混合精度,以大幅加速 Transformer 模型的 AI计算。采用 FP8 的 Tensor Core 运算在吞吐量方面是 16 位运算的两倍。Transformer引擎利用定制的、经 NVIDIA 调优的启发式算法来解决上述挑战,该算法可在 FP8 与FP16 计算之间动态选择,并自动处理每层中这些精度之间的重新投射和缩放。根据英伟达提供的数据,Hopper 架构在训练 Transformer 模型时,效率可以达到安培模型的 9 倍。

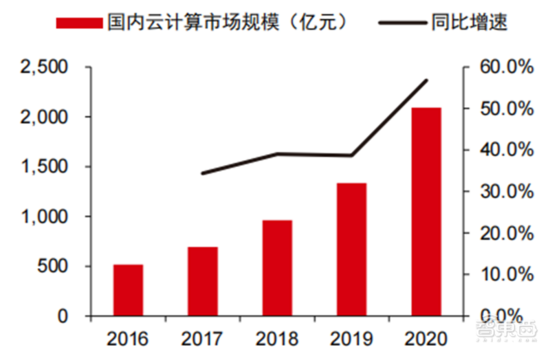

在大模型技术趋势下,云厂商正在逐步成为算力市场中的核心玩家,在人工智能技术框架通过大模型往泛用化发展后,云厂商也能够借助 PaaS 能力把底层 IaaS 能力与 PaaS结合,为市场提供通用性解决方案。我们看到随着大模型的出现,人工智能需要处理与分析的数据量日渐上升,同时这部分数据从过去的专业性数据集转化为通用型大数据。云计算巨头可以通过本身强大的 PaaS 能力与底层 IaaS 基础相结合,为人工智能厂商提供一站式的数据处理,这也帮助云计算巨头成为本轮人工智能浪潮的主要受益者之一。

▲ 国内云计算市场规模

目前 AWS、Azure 等国际主流云厂商与阿里云、腾讯云、华为云等国内头部云厂商都已开始在数据储存、数据处理等 PaaS 能力上重点发力。存储能力方面,NoSQL 类型数据库与在数据种类日益繁杂的未来会涌现更多机会,如 Google Cloud 就已经在对象类、传统的关系型数据库以及 NoSQL 类型数据库分散布局。而在数据处理方面,Data Lake与 Data Warehouse 的重要性愈发凸显,云计算巨头通过完善这部分产品线,构建了一个完整的数据循环模式,并结合其底层的 IaaS 基础能力。完整的产品线与闭合的数据循环模式将是未来云计算巨头在 AI 中间层竞争的最大优势。

伴随 AI 产业链结构的逐步清晰,以及大模型带来的产业运作效率、技术深度的大幅改善,中期维度,假设 AI技术不发生跳变式跃迁前提下,我们判断 AI 产业链价值有望逐步向两端靠拢,中间环节价值有望持续减弱,并逐步形成“芯片+算力基础设施+AI 框架&算法库+应用场景”的典型产业链结构,同时在这样的产业结构安排下,我们预计上游的芯片企业、云基础设施厂商,以及下游的应用厂商有望逐步成为 AI 产业快速发展的核心受益者。

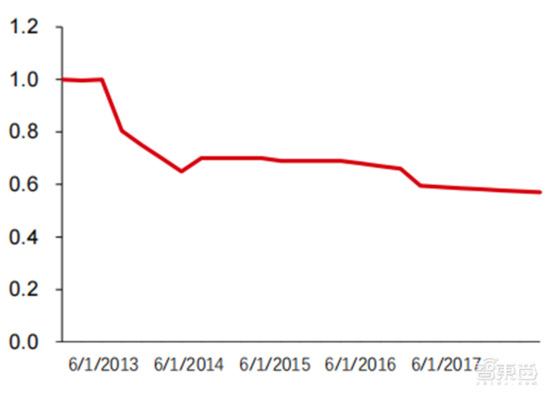

大模型带来 AI 底层基础技术架构的统一,以及对算力的庞大需求等特征,天然有利于云计算公司在此过程中发挥基础性角色:云计算具有全球分布最为广泛、最为强大的硬件算力设施,同时 AI 框架、通用算法最为一种典型 PaaS 能力,亦倾向于被整合到云厂商的平台能力当中。因此从技术通用性、实际商业需求等维度,在大模型的推动下,云计算巨头有望逐步成为算力设施+基础算法框架环节能力的主要提供商,并不断侵蚀现有的 AI 算法平台商的商业空间。从过去云厂商各类产品的报价中可以发现,以 AWS 与 Google 产品为例,美国东部地区的 Linus按需使用价格正在阶梯式降低。

从图中可以看到,具有 2 个 vCPU,2 个 ECU 和 7.5GiB的 m1.large 产品价格从 2008 年的约 0.4 美元/小时持续下降到了 2022 年约 0.18 美元/小时。而 Google Cloud 具有 8 个 vCPU 与 30GB 内存的 n1-standard-8 产品的按需使用价格也从 2014 年的 0.5 美元/小时下降到 2022 年的 0.38 美元/小时,可见云计算价格呈全面下降趋势。在未来 3-5 年,我们将看到更多的 AI 即服务(AIaaS)产品。此前提到的大模型趋势,尤其是 GPT-3 的诞生掀起了这个潮流,由于 GPT-3 庞大的参数量,必须要在庞大的公有云算力如 Azure 规模的计算设施上才能运行,于是微软将它打造成了能够通过web API 获取的服务,这也会促使更多的大模型出现。

▲ AWS EC2 历史标准化价格(美元/小时)

在目前的算力条件与可展望的技术能力支持下,应用端将继续通过数据获取实现算法迭代与优化,完善目前认知智能当中仍存在的不足(图像识别方向),并尝试往决策智能发展。根据目前的技术能力以及硬件算力支持,实现完全决策智能仍需较长时间;现有场景的继续深化的基础上做出局部性的智能化将是 3-5 年内的主要方向。目前的 AI 应用层面仍然过于单点化,而完成局部性的串联将成为实现决策智能的第一步。人工智能的软件类应用将包括从底层的驱动程序,到上层的应用程序、算法框架,从面向商业(制造、金融、物流、零售、地产等),到人(元宇宙、医疗、人形机器人等)、自动驾驶等领域。

智东西认为,伴随 AI 芯片、算力设施、数据等基础要素的不断完善,以及大模型带来的问题泛化求解能力的大幅提升,AI 产业正形成“芯片+算力基础设施+AI 框架&算法库+应用场景”的稳定产业价值链结构,AI 芯片厂商、云计算厂商(算力设施+算法框架)、AI+应用场景厂商、平台型算法框架厂商等有望持续成为产业核心受益者。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK