黄仁勋:英伟达的 AI 算力,已经「1 折」出售

source link: https://www.geekpark.net/news/321155

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

黄仁勋:英伟达的 AI 算力,已经「1 折」出售

从数据找业务,到业务找数据,大模型带来商业变革。

作者 | 凌梓郡、Li Yuan

编辑 | 靖宇

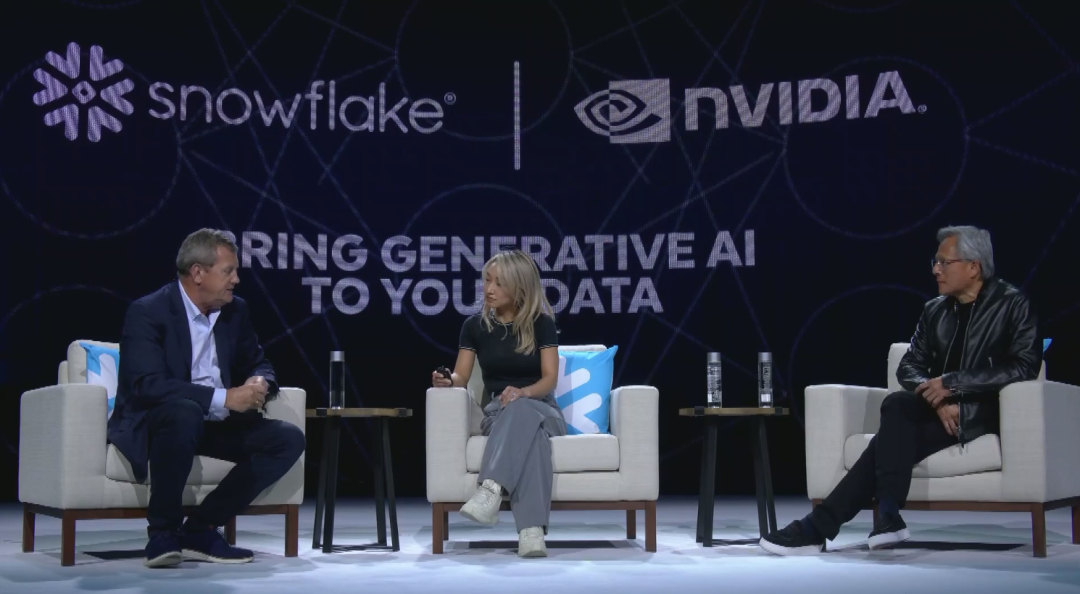

身穿皮夹克的黄仁勋,站在蓝色冲浪板上,摆了几个冲浪的姿势。

这不是美国「网红节」VidCon,而是美国知名数据平台 Snowflake 的开发者大会上的一景。

当地时间 6 月 26 日,英伟达创始人黄仁勋和 Snowflake 公司 CEO Frank Slootman 就「如何把生成式 AI 带给企业用户」展开探讨。主持人则是前 Greylock 的 GP,现在是投资机构 Conviction 的创始人。

在会上,相较于「东道主」Frank 职业经理人式的老成持重,「皮衣教父」一如既往地语出惊人,不仅称双方的合作是「要相爱,不要战斗」(We are Lovers,not Fighters),更开玩笑说,为 Snowflake 提供的经过训练的模型,相当于给客户「打了 1 折」。

当天,英伟达与 Snowflake 又共同放出大招:世界第一芯片公司与风头最劲的云数据平台合作,推出共同合作。Snowflake 的用户可以在数据不离开平台的前提下,直接利用英伟达的预训练 AI 模型,在云平台上对自己公司的数据进行分析,开发针对自己数据的「AI 应用」。

「目前的重大变革来自数据+AI 算法+计算引擎。通过我们的合作,我们的能够将这三点带到一起。」黄仁勋讲道。

Talking Points:

- 大语言模型+企业专属数据库=针对特定问题的 AI 应用;

- 以前是 Data going to Work,现在是 Work going to Data,让计算去到数据所在之地,避免数据孤岛;

- 英伟达提供的预训练模型,已经是花费数千万美元、在英伟达 AI 工厂中训练出来的,所以在 Snowflake 上调用计算引擎已经「打了 0.5 折」;

- 软件 3.0 时代,基于模型、数据库,企业能够在几天内搭建自己的专属应用;

- 未来企业能够生产许多智能代理,并运行它们;

- 对于企业来说,真正的难题是混合结构的、非结构化的数据,如何被调动。这或许能够带来商业模式的更新。

以下为双方对话主要内容,经极客公园整理编辑:

谈合作:把最好的计算引擎,

带给最有价值的数据

Frank:

NIVIDA 目前在历史上发挥着重要的作用。对于我们来说,能够带来数据和大型企业的关系。我们需要启用这项技术,以及让整个服务堆栈来有效地使用它。我不想使用「天作之合」来形容,但是对于一个门外汉,是一个很好的机会,进入到这扇机会的大门里。

我们是 lovers,而不是对手。我们要把世界上最好的计算引擎带到世界上最有价值的数据。回想过去,我已经工作了很长时间,但是还没有那么老。Frank,你更老一些(笑)。

最近,由于众所周知的原因,数据是巨大的,数据是宝贵的。它必须是安全的。移动数据很困难,数据的引力真实存在。因此,对我们来说,把我们的计算引擎带到 Snowflake 上要容易得多。我们的伙伴关系是加速 Snowflake,但它也是关于将人工智能带到 Snowflake。

最核心的是,数据+人工智能算法+计算引擎的组合,我们的伙伴关系将所有这三件事结合在一起。令人难以置信的有价值的数据,令人难以置信的伟大的人工智能,令人难以置信的伟大的计算引擎。

我们可以一起做的事情,是帮助客户使用他们的专有数据,并用它来编写 AI 应用程序。你知道,这里的重大突破是,你第一次可以开发一个大型语言模型。你把它放在你的数据前面,然后你与你的数据交谈,就像你与一个人交谈一样,而这些数据将被增强到一个大型语言模型中。

大型语言模型加知识库的组合等于一个人工智能应用。这一点很简单,一个大型的语言模型将任何数据知识库变成一个应用程序。

想想人们所写的一切惊人的应用程序。它的核心始终是一些有价值的数据。现在你有一个查询引擎通用查询引擎在前面,它超级智能,你可以让它回应你,但你也可以把它连接到一个代理,这是 Langchain 和向量数据库带来的突破。将数据和大语言模型叠加的突破性的东西正在到处发生,每个人都想做。而 Frank 和我将帮助大家做到这一点。

软件 3.0:建立 AI 应用,

解决一个特定问题

作为投资者来看这种变化,软件 1.0 是非常确定的代码,由工程师按照功能写出来;软件 2.0 是用仔细收集的标记的训练数据优化一个神经网络。

你们在帮助人们撬动软件 3.0,这套基础模型本身有令人难以置信的能力,但它们仍然需要与企业数据和自定义数据集合作。只是针对它们去开发那些应用程序要便宜得多。

对于那些深入关注这个领域的人来说有一个问题,基础模型是非常泛化,它可以做所有事情吗?为什么我们需要自定义模型和企业数据呢?

Frank:

所以我们有非常泛化的模型,可以做诗,处理《了不起的盖茨比》的做摘要,做数学问题。

但是在商业中,我们不需要这些,我们需要的是一个 Copilot,在一个非常狭窄,但是非常复杂的数据集上获得非凡的洞见。

我们需要了解商业模式和商业动态。这样的计算上不需要那么昂贵,因为一个模型并不需要在一百万件事情上接受训练,只需要知道非常少的、但很深入的主题。

举个例子。我是 Instacart 的董事会成员,我们一个大客户,像 DoorDash 和所有其他企业常面临的问题是,他们不断增加营销费用,来了一个客户,客户下了一个订单,客户要么不回来,要么 90 天后回来,这非常不稳定。他们把这称为流失客户。

这是复杂问题的分析,因为客户不回来的原因可能有很多。人们想找到这些问题的答案,它在数据中,不在一般的互联网中,而且可以通过人工智能找出来。这就是可能产生巨大价值的例子。

这些模型应该如何与企业数据互动?

我们的战略和产品是各种尺寸、最先进的预训练模型,有时你需要创建一个非常大的预训练模型,以便它可以产生 prompt,来教更小的模型。

而较小的模型几乎可以在任何设备运行,也许延迟非常低。然而它的泛化能力并不高,zero shot(零样本学习)能力可能更有限。

因此,你可能有几种不同类型不同大小的模型,但在每一种情况下,你必须做监督的微调,你必须做 RLHF(人类反馈的强化学习),以便它与你的目标和原则保持一致,你需要用矢量数据库之类的东西来增强它,所以所有这些都汇集在一个平台上。我们有技能、知识和基本平台,帮助他们创建自己的人工智能,然后将其与 Snowflake 中的数据连接起来。

现在,每个企业客户的目标不应该是思考我如何建立一个大型的语言模型,他们的目标应该是,我如何建立一个人工智能应用程序来解决特定的问题?那个应用可能需要 17 个问题来做 prompt,最终得出正确的答案。然后你可能会说,我想写一个程序,它可能是一个 SQL 程序,可能是一个 Python 程序,这样我就可以在未来自动做这个。

你还是要引导这个人工智能,让他最终能给你正确的答案。但在那之后,你可以创建一个应用程序,可以作为一个代理(Agent)24/7 不间断地运行,寻找相关情况,并提前向你汇报。所以我们的工作就是帮助客户建立这些人工智能的应用,这些应用是有安全护栏的、具体的、定制的。

最终,我们在未来都将成为智能制造商,当然雇用员工,但我们将创建一大堆代理,它们可以用 Lang Chain 类似的东西来创建,连接模型、知识库、其他 API,在云中部署,并将其连接到所有的 Snowflake 数据。

你可以规模化地操作这些 AI,并不断地完善这些 AI。因此,我们每个人都将制造 AI、运行 AI 工厂。我们将把基础设施放在 Snowflake 的数据库,客户可以在那里使用他们的数据,训练和开发他们的模型,操作他们的 AI,因此,Snowflake 将是你的数据存储库和银行。

有了自己的数据金矿,所有人都将在 Snowflake 上运行 AI 工厂。这是目标。

「核弹」虽贵,

直接用模型相当于「打 1 折」

我们在 NIVIDA 建立了有五个 AI 工厂,其中四个是世界前 500 名的超级计算机,另一个正在上线。我们使用这些超级计算机来做预训练模型。因此,当你在 Snowflake 中使用我们的 Nemo AI 基础服务时,你将得到一个最先进的预训练模型,已经有几千万美元的费用投入其中,更不用说研发投入了。所以它是预先训练好的。

然后有一大堆其他的模型围绕着它,这些模型用于微调、RLHF。所有这些模型的训练成本都要高得多。

因此,现在你已经将预训练模型适应于你的功能,适应于你的护栏,优化你希望它具有的技能或功能类型,用你的数据增强。因此,这将是一个更具成本效益的方法。

更重要的是,在几天内,而不是几个月。你可以在 Snowflake 开发与你的数据连接的人工智能应用程序。

你应该能够在未来快速建立人工智能应用程序。

因为我们现在看到它正在实时发生。已经有一些应用能够让你和数据聊天,比如 ChatPDF。

是的,在软件 3.0 时代,95% 的培训费用已经由别人承担了。

(笑)是的,95% 的折扣,我无法想象一个更好的交易。

这是真正的动力,作为投资人,我看到在分析、自动化、法律等领域的非常年轻的公司,他们的应用已经在六个月或更短的时间内实现了真正的商业价值。其中一部分原因是他们从这些预先训练好的模型开始,这对企业来说是一个巨大的机会。

每家公司都会有数百个,甚至 1000 个人工智能应用程序,只是与你公司的各种数据相连。所以,我们所有人都必须善于构建这些东西。

原来是数据找业务,

现在是业务找数据

我一直从大企业参与者听到的一个问题是,我们必须去投资人工智能,我们需要一个新的堆栈(Stack)吗?应该如何考虑与我们现有的数据堆栈相连?

Frank:

我认为它在不断发展。模型们正逐渐变得更简洁、安全、更好地被管理。所以,我们没有一个真正明确的观点,这就是每个人都会使用的参考架构?有些人将有一些中央服务的设置。微软有 Azure 中的人工智能版本,它们的很多客户正在与 Azure 进行互动。

但我们不清楚什么模型将主导,我们认为市场将在使用难易、成本这些事上进行自我排序。现在仅仅是开始,不是最终的状态。

安全部门也会参与进来,关于版权的问题会被革新。现在我们对技术很着迷,现实中的问题也会被同时处理。

我们现在正经历 60 年来第一次根本性的计算平台变革。如果你刚刚读了 IBM System 360 的新闻稿,你会听到关于中央处理单元、IO 子系统、DMA 控制器、虚拟内存、多任务、可扩展计算向前和向后端兼容,而这些概念,实际都是 1964 年的东西,而这些概念帮助我们在过去六十年来,不断进行 CPU 扩展。

这样的扩展已经进行了 60 年了,但这已经走到了尽头。现在大家都明白,我们无法再扩展 CPU 了,突然之间,软件变化了。软件的编写方式,软件的操作方式,以及软件能做的事情都与以前有很大的不同。我们称之前的软件为软件 2.0。现在是软件 3.0。

事实就是,计算已经从根本上改变了。我们看到两个基本的动力在同时发生,这也是为什么现在事情正在发生剧烈震荡。

一方面,你不能再不断地购买 CPU。如果你明年再买一大堆 CPU,你的计算吞吐量将不会增加。因为 CPU 扩展的终点已经到来了。你会多花一大堆钱,你不会得到更多的吞吐量。因此,答案是你必须去加速(英伟达加速计算平台)。图灵奖获得者谈到了加速,英伟达开创了加速,加速计算现在已经到来。

另一方面是,计算机的整个操作系统发生了深刻的改变。我们有一个叫 NIVIDA AI Enterprise 的层,而其中的数据处理、训练、推理部署,整个现在已经整合到或正在整合到 Snowflake 中,因此,从开始数据处理,一直到最后的大模型部署,整个背后的计算引擎都被加速了。我们将赋能 Snowflake,在这里你将能够做得更多,而且你将能够用更少的资源做到更多。

如果你去任何一个云,你会看到 NVIDIA GPU 是其中最昂贵的计算实体。但是,如果你把一个工作负载放在上面,你会发现我们做得非常快。就好像你得到了一个 95% 的折扣。我们是最昂贵的计算实体,但我们是最具成本效益的 TCO。

所以,如果你的工作是运行工作负载,可能是训练大型语言模型,可能是微调大型语言模型,如果你想这样做,一定要进行加速。

加速每一个工作负载,这就是整个栈的重塑。处理器因此发生变化,操作系统因此不同,大的语言模型是不同的,你写 AI 应用程序的方式是不同的。

未来,我们都要写应用。我们都要把我们的 prompt 和我们的上下文,和少数几个 Python 命令连接起来,连接到大语言模型和自己的数据库或者公司的数据库中,开发自己的应用程序。每个人都将成为一个应用程序的开发者。

但不变的是,它仍然是你的数据。你仍然需要对它进行微调。

Frank:

原来我们都觉得更快的总是更贵的。实际上突然之间,更快的是更便宜的,这是一种反直觉的东西。因此,有时人们想减少供应,以为这样更便宜,结果却更贵。

另一个与之前矛盾的是,原来都是数据去找业务(data going to work),而现在,业务去找数据 (work going to data)。过去的六十年,或者更多年,我们一直在让数据去找业务,这导致了大规模的信息孤岛。而如果你想拥有一个 AI 工厂,用之前的做法将是非常困难的。我们必须把计算带到数据所在的地方。我认为我们现在正在做的就是正确的方式。

企业如何获得

最快和最大的价值

Frank:

最快和获得最大价值其实是两个很不一样的问题。

最快的话,你很快能够看到,数据库各处都上线了人工智能增强的搜索方式,因为这是最容易增加的功能。现在,甚至一个文盲都能从数据中获取有价值的信息,这真非常不可思议,这是终极的交互民主化。搜索功能极大增强,你就向主界面提一个问题,它们可以把这些问题带到数据自己进行查询。这是挂在低处的果实,最容易的,我们认为这是阶段一。

接下来,我们就开始真正关注真正的难题,就是专有的企业数据,混合结构化的、非结构化的,所有这些,我们如何调动这些数据?

我前面已经提到了 to C 企业面临的流失率问题,供应链管理方面的问题。当供应链特别复杂的时候,如果有一个事件发生了,我们如何重新调整一个供应链,使其运转?我现在该怎么做?供应链是由很多不同的实体组成的,不是单一的企业。历史上,这是一个从未被计算解决过的问题。供应链管理从来没有形成过一个平台,它几乎是一个电子邮件,电子表格形成的体系,除了一些小的例外。因此,这是极其令人兴奋的。

或者我们可以重新计算大型的呼叫中心的投资,优化零售的定价,像我说的,这是一个大企业的 CEO 们一直期待的重新定义商业模式,是真正的潜力。

对企业的建议:

我会问自己,第一,什么是我唯一最有价值的数据库?第二件事,我会问自己,如果我有一个超级、超级、超级聪明的人,而企业的一切数据都经过那个超级智能,我会问那个人什么?

根据每个人的公司,这是不同的。Frank 的公司客户数据库非常重要,因为他有很多客户。而我自己的公司,没有那么多客户,但对我的公司而言,我的供应链超级复杂,而且我的设计数据库也超级复杂。

对 NIVIDA 来说,没有人工智能我们已经无法建造出GPU。因为我们的工程师都不可能像AI那样,为我们进行大量的迭代和探索。因此,当我们提出人工智能的时候,第一个应用在我们自己的公司。而且,所以 Hopper(英伟达超算产品)不可能没有人工智能的设计。

我们也会将我们自己的 AI 应用于我们自己的数据中。我们的错误数据库就是一个完美的应用场景。如果你看一下 NIVIDA AI 的代码量,我们有几百个软件包,结合在一起,支持一个应用程序能够跑起来。我们现在正在努力的一些事情,就是如何使用 AI 去弄清楚如何给它打安全补丁,如何最好地维护它,这样我们就可以不必干扰整个上层应用层的同时,能够向后端兼容。

这都是 AI 能够为你提供答案的。我们可以用一个大语言模型去回答这些问题,为我们找到答案,或者向我们揭示一些问题,然后工程师就可以再将其修好。或者 AI 可以推荐一个修复方法,人类工程师再去确认这是不是一个好的修复方法。

我觉得不是所有人都认识到了他们每天都在处理的数据里面,其实蕴含着多少智能、洞见和影响力没有被发掘。这就是为什么我们所有人都要参与进来,帮助带来这样的未来。

现在,你储存在数据仓库的数据,第一次可以被连接进人工智能工厂。你将能够生产信息情报,这是世界上最有价值的商品。你坐在一个自然资源的金矿上——你公司的专有数据,而我们现在把它连接到一个人工智能引擎上,另一端每天直接产生信息情报,以难以置信的情报量从另一端涌出,甚至在你睡觉时也在源源不断地产出。这是有史以来最好的事情。

*头图来源:视觉中国

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK