影史最出名的反派之一,未来都「不说人话」

source link: https://www.ifanr.com/1514687

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

李安的动作科幻电影《双子杀手》里,政府特工亨利正准备退休,却发现被一个比自己年轻 23 岁的克隆体追杀。

为了达到这个效果,李安用动作捕捉特效精致还原人脸,让威尔·史密斯「返老还童」。某位拥有「完美的 23 岁皮肤」的年轻男子,也为克隆体贡献了自己的数据。

没有人永远年轻,永远有人正年轻。

但「数字替身」完全可以更贪心,除了有不老的皮囊,还可以有不老的声音。

召唤时光机

《星球大战》的达斯·维德(Darth Vader),因身心俱毁而堕入原力的黑暗面,在正传三部曲里为头号反派,也是星球大战系列中最具矛盾与悲剧色彩的人物。

2003 年,美国电影学会将达斯·维德列为百年来第三伟大的电影反派,仅次于《沉默的羔羊》的汉尼拔和《惊魂记》的诺曼·贝茨。

从 1977 年卢卡斯出品第一部《星球大战》以来,詹姆斯·厄尔·琼斯一直为达斯·维德配音,算到如今差不多贯穿了一个人的半生,他的声音也就成了角色的声音。

▲ 图片来自:screenrant

达斯·维德有力却略为低沉的嗓音,配上深重的呼吸声,令人脊背发凉。

但人类终将老去,琼斯今年已经 91 岁,该考虑结束配音生涯了,他决定将声音授权给乌克兰初创公司 Respeecher。

通过从前的录音和专有的 AI 算法,Respeecher 可以用旧的声音创建新的台词。

▲ Respeecher. 图片来自:inverse

最新的成果,便是今年 6 月完结的星球大战衍生剧《欧比旺·克诺比》。

剧中,Respeecher 重现了琼斯几十年前的音色,而不是他在 2019 年《星球大战:天行者崛起》中因岁月而苍老的真实声线。

和 Respeecher 合作的卢卡斯影业声音监督编辑 Matthew Wood 表示,像达斯·维德这样的角色,50 条台词可能需要近 1 万多个文件来回切换,大部分工作都耗在对话的变化和微调上。

一个有趣的细节是,在达斯·维德出场的《欧比旺·克诺比》第 3 集,Respeecher 也被列入了演职员表。

▲ 图片来自:Lucasfilm

这并不是 Respeecher 第一次和卢卡斯影业合作,它还为星球大战衍生剧《曼达洛人》和《波巴·费特之书》中年轻版的卢克·天行者「配音」。

星球大战三部曲在 1977 年至 1983 年上映,当时饰演卢克·天行者的马克·哈米尔,今年也已经 70 岁了。

《曼达洛人》第二季最后一集,不到 20 岁的卢克·天行者出场,形象是视觉效果公司 Lola VFX 用 Deepfake 和替身制作的,声音则由 Respeecher 负责「克隆」。

▲《波巴·费特之书》卢克·天行者 CGI.

▲ 1983《星球大战 VI》卢克·天行者.

Respeecher 所做的是,输入数小时的高质量录音,用 AI 语音合成软件和音频超分辨率算法分析语音,直到系统具备「克隆」能力。

就像克隆羊需要 DNA,克隆声音也是有输入才有输出,录音的说话风格、起伏跌宕等细节都非常重要。

所以,这项工作仍然与人高度相关。「技术还不会创造表演」,没有过往的真人表演,那么 Respeecher 就束手无策。

从这个角度看,Respeecher 的 AI 如同搭乘时光机的发声装置——它重现了某人过去的某个特定时刻。

▲《曼达洛人》卢克·天行者.

为了让年轻的天行者重现,Respeecher 收集了马克·哈米尔 1983 年前后的配音、采访、对白补录、无线电广播等资源。

这里还有一处难点:让近 40 年历史的数据听起来像是昨天刚录制好的。

最终,卢克·天行者只在两部衍生剧说了几行话。不过,无需以数量论短长,确保合成语音无法与原始语音区分,观众完全意识不到真实与否,才是 Respeecher 想要的结果。

这家成立于 2018 年的初创公司目标很简单:克隆不让人起疑的人类语音。

跨越病痛和生死

人类生来受限,逃不过老病死,但技术可以扩充肉身的边界。

克隆名人声音,并不是第一次,也不会是最后一次。

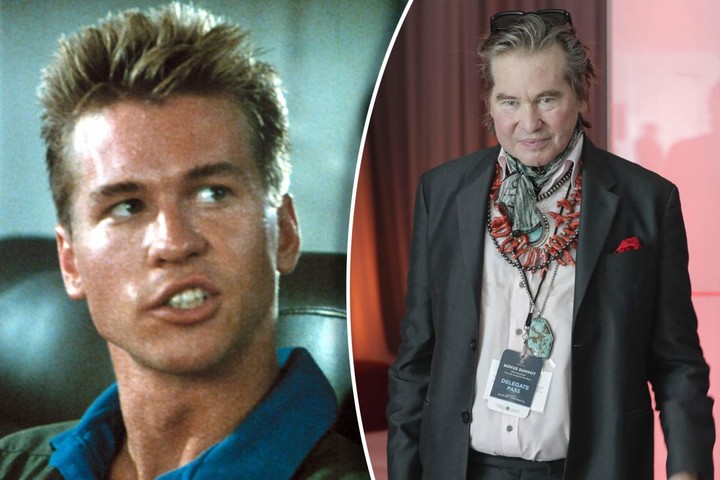

2022 年上映的《壮志凌云:独行侠》是 1986 年《壮志凌云》的续集,片中「冰人」卡赞斯基再次被 62 岁的瓦尔·基尔默(Val Kilmer)搬上银幕。

但回归没有那么容易,从 2014 年接受喉癌治疗开始,基尔默永远失去了他的声音。

所以,《壮志凌云:独行侠》的剧本从基尔默的现实生活取材,「冰人」也患有癌症并通过打字交流,在片中只说了一句简短的台词。

▲ 图片来自:pagesix

而在现实生活中,基尔默的声音已经通过 AI「恢复」。2020 年,基尔默开始与 AI 语音公司 Sonantic 合作。

收到数小时的旧录像后,Sonantic 首先在不破坏语音内容的前提下去除背景噪音,再从音频中生成脚本,并将音频和文本一块块地配对,然后语音引擎用这些数据训练语音模型。

难点在于,基尔默提供的数据比他们以往的项目少了大约 10 倍。为此,Sonantic 研究了新的算法,最终生成了 40 多种不同的语音模型,把其中最好的一个交给基尔默。

▲ 图片来自:vanityfair

有了自定义语音模型,基尔默和他的团队输入文本,选择合适的模式,调整音调、节奏等参数,就能实现逼真的交流。

这不仅仅是一项技术成果,还关乎人与人的沟通和联系。基尔默本人在一份声明中提到:

作为人类,沟通能力是我们生存的核心,喉癌的影响让其他人很难理解我。有机会以一种真实而熟悉的声音讲述我的故事,这是一份非常特别的礼物。

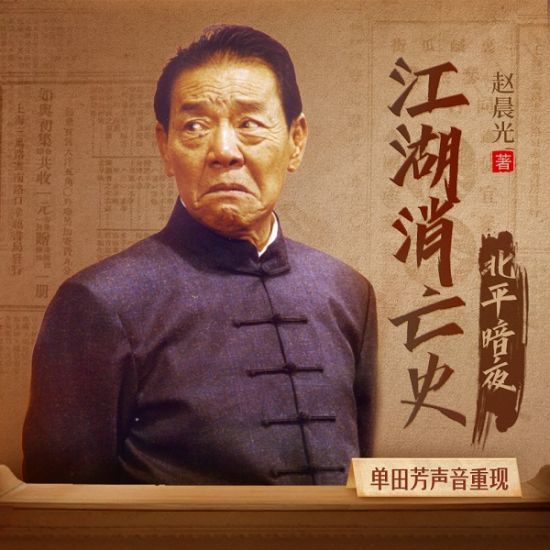

国内也有这样的例子。2021 年,喜马拉雅以语音合成技术让已故大师单田芳「再说」评书;2018 年,《创新中国》纪录片用 AI 复原配音大师李易的声音。

所以当你曾经在世界留下过痕迹,就无法轻易「事了拂衣去、深藏功与名」。

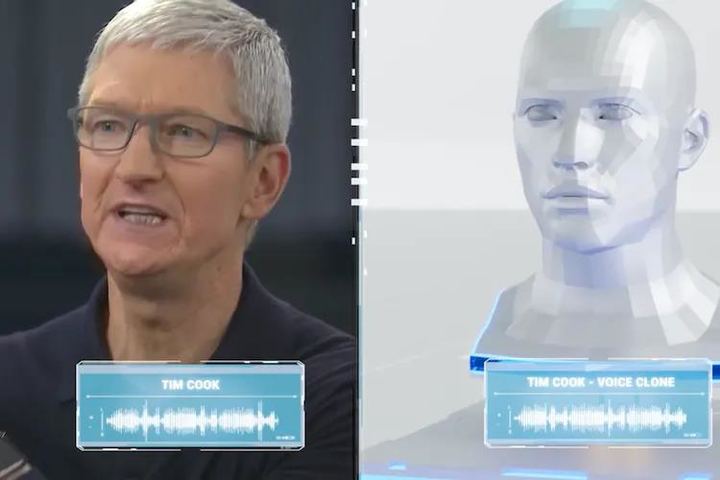

对于仍要谋生的名人,克隆语音倒可能是条「通天大道」。如果说 AI 换脸模型 Deepfake 让明星「出租」脸就可能赚得盆满钵满,语音模型也不相上下。

为基尔默「恢复」声音的 Sonantic 还有一项业务:为嗓子正常的演员创建声音模型。

▲ 图片来自:the verge

平台先提供设置脚本,演员录制好这些脚本的表演,然后再将录制的音频输入语音引擎,用引擎训练 AI 模型。最终,当合成声音被商用,演员们躺着就能获得利润分成,无需亲力亲为,也不必担心分身乏术。

2021 年 5 月,美国 AI 技术公司 Veritone 也推出了类似的平台 Marvel.AI。这家公司认为,「对于运动员、演员和 KOL,声音是他们个人品牌的巨大资产」。

▲ 图片来自:Veritone

但这不免有偷懒之嫌,如果明星都不愿自己代言,消费者又凭什么为他们买单?Veritone 建议创建行业标准,比如提前告知听众是合成语音,那就是「一个愿打一个愿挨」了。

有技术和平台,名人克隆和出租声音完全可以是产业链,这也是技术跨越肉体与时空限制的一种体现。

人人拥有「语音替身」的未来还远吗

诚然,语音克隆不是新鲜事,但它仍然需要一个越来越真实、简易的过程,远远没有抵达终点。

在我们看得到或看不到的角落,语音克隆的普及度越来越高,不只是名人、明星等少数人的游戏。

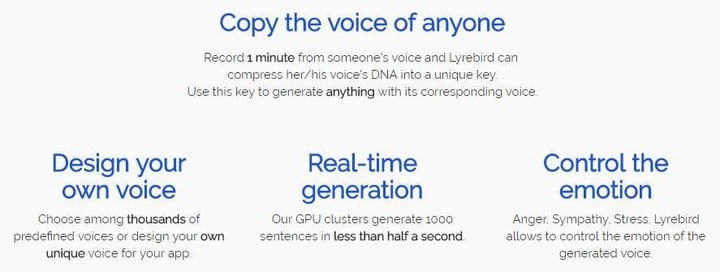

2017 年,加拿大 AI 初创公司 Lyrebird 开发了一种语音合成技术,声称他们的算法能用 1 分钟的样本音频克隆任何人的声音。

▲ Lyrebird.

1 分钟是个了不起的数字。当年 Adobe 的 Project VoCo,至少需要 20 分钟的样本音频。

在 Lyrebird 给出的例子里,希拉里、克林顿、特朗普言笑晏晏,共同祝福 Lyrebird 有美好未来。他们的声音、语调还是和真人有些区别,机械感略重,但足够让人眼前一亮了。

Lyrebird 表示,生成声纹需要相当多的计算能力,但一旦完成这一步,制作语音很容易,创建一千个句子不到半秒。

这像是一则预言:越过真实和机械的门槛,之后便一马平川。

除了所需的样本音频更少,语音克隆也已经被内置在随手可及的创作工具中。

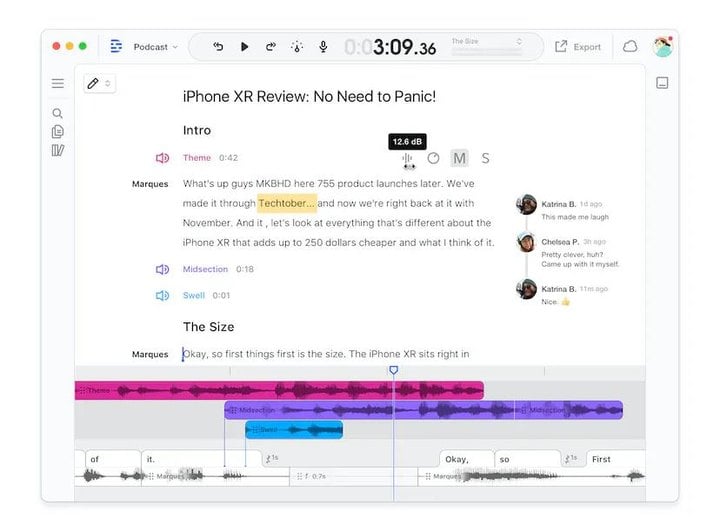

▲ Descript.

美国音视频编辑公司 Descript 开发了播客编辑功能「Overdu」,它可以克隆创作者的声音,创作者输入需要的单词,就能用原有声音生成新的音频,方便快速修改播客。

但它也远非完美。The Verge 记者体验后发现,一方面,为了训练 AI,需要预先录制很多音频;另一方面,生成的音频缺乏情感和抑扬顿挫,偏偏听起来确实是自己,令人心生怪异又莫名熟悉。

当初创公司遍地开花,大型科技公司厚积薄发。

今年 6 月的 Amazon re:MARS 大会上,亚马逊首席科学家 Rohit Prasad 表示,亚马逊正在开发一种技术,允许智能助手 Alexa 通过不到 1 分钟的音频模仿任何人的声音。

▲ 图片来自:techcrunch

任何人当然也包括已故亲人。亚马逊还做了一次相关演示:一个孩子对 Alexa 说要听睡前故事《绿野仙踪》,扬声器传出的声音不是常见的机械音,而是已故祖母的声音。

亚马逊没有透露 Alexa 新功能的更多细节,但底层技术已经存在了好几年。

可以预见,虽然语音克隆还无法真正代替人声,但运用将相当广泛,比如有声读物、语音助手、视频游戏等。

Sonantic 曾说:「CGI(计算机生成图像)为视觉所做的,就是 Sonantic 为音频所做的。」人人拥有自己的「语音替身」,或许已经近在眼前。

而翻到硬币的另一面,我们对「语音替身」态度谨慎。

▲ 图片来自:Face2Face

毕竟,Deepfake 的政治谎言、色情内容造成了不少负面影响,也就不难想象,语音模型会被用来做些什么。如果不加防范,我们将有一个照片可以伪造、录音也并不可靠的未来。

几个月前,微软发布了新的 AI 道德规则,将严格限制谁可以创建合成声音,如何使用合成声音,并为人造声音覆盖防止滥用的「水印」。

为《星球大战》兢兢业业的 Respeecher,曾发布过一部「1969 年」的短片,片中总统宣布月球上发生大规模灾难,听起来十分「真实」,但一切都是假的。

短片在最后提醒道:「这个项目使用了一系列的技术,包括视频对话替换、语音转换系统以及更传统的视频编辑,展示了错误信息可能的样子。请核实你的信源。」

所以,Respeecher 并不是想证明新闻和历史都能被操纵。

恰恰相反,他们希望让人们意识到技术的存在和用处,以及技术的局限和恶意。既然车轮已经滚滚向前,被更多地看见,才能被更好地规范和使用。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK