深度学习公式推导(2):激活函数与偏置

source link: https://blog.51cto.com/u_14279308/5582934

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

深度学习公式推导(2):激活函数与偏置

精选 原创

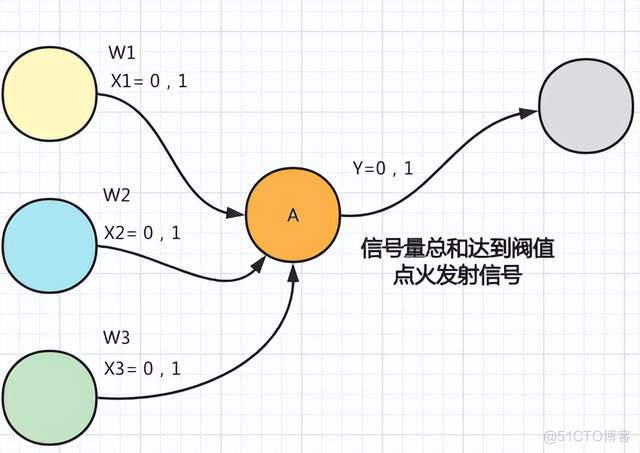

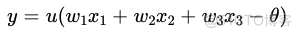

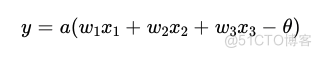

上一节讲到神经元接受到信号量以后点火的公式:

x1、x2、x3是否有信号输入,w1 、w2、w3 是信号量的权重,θ 是点火的阀值,最后得到的结果y 表示是否点火, 结果 0 表示 不点火, 结果1 表示点火。

激活函数

虽然通过上面的公式我们可以得到y 是否点火,这里有一个假设,也就是y 只有两种结果,也就是点火或者是不点火。

所以,上面的公式是一个阶跃函数,结果是0和1,也就是线性函数。

但是在实际情况中 y 点火这件事情是存在概率的,例如 64% 的机率点火,有36%的机率不点火。为了达到这个效果就需要将 线性函数转化成非线性函数,这里就需要引入激活函数,激活函数可以将点火这件事的概率描述清楚。

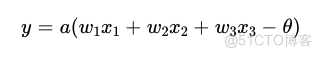

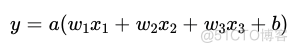

如果说我们将这个激活函数称作a 的话,那么就将公式变为如下样子:

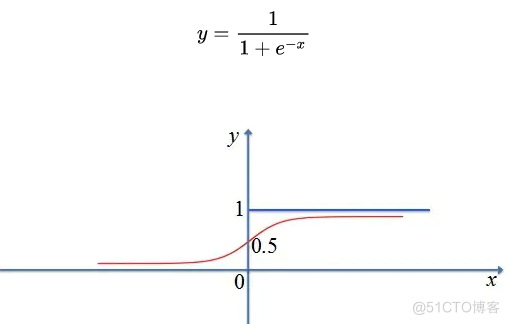

具体的激活函数a,可以用Sigmoid 函数来代替。

当引入Sigmoid 函数之后,会把y的结果设定为从0 到1 之间的数字,无论x 的取值是多少,这样就把线性函数变成了非线性函数,描述y发射的概率问题。这里不对Sigmoid函数进行深入的讨论,大家只要知道Sigmoid是一种激活函数,在这里可以描述发射概率问题。(当然在其他场景也有不同的描述)

偏置

根据上面激活函数的折腾,我们得到了如下的公式;

其实这个公式就是把之前的函数u改成了a(激活函数)。

由于公式中的 θ 前面有一个“-”(符号),为了计算方便将其进行替换成b,b 就等于 “-θ”,这样公式就变成如下的样子:

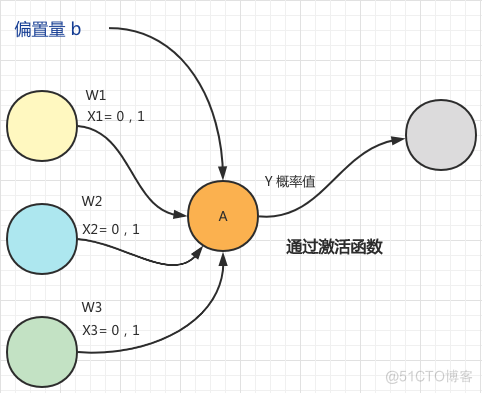

上图中的b 就是偏置,有了这个概念以后神经元图就改成如下的样子:

如上图所示,除了原来的输入,还加入了一个偏置量 b。

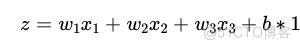

那么加权输入z 的表达式就可以看成如下的公式:

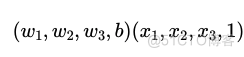

将上面的公式进行进一步的转换, 就变成了如下两个向量的内积形式。计算机擅长内积的计算,因此按照这种解释,计算就变容易了。

- 打赏

- 赞

- 收藏

- 评论

- 分享

- 举报

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK